di Edoardo Puglielli

Da Luigi Berlinguer a Valditara la politica scolastica è sempre la stessa. Draghi sostiene che «i sistemi di istruzione e formazione devono essere resi più reattivi ai cambiamenti del mercato del lavoro. La revisione dei programmi di studio, con il coinvolgimento di datori di lavoro e altre parti interessate, risulta fondamentale per adattare l’offerta formativa alle esigenze individuate dalla skills intelligence» (cfr. https://www.orizzontescuola.it/sistema-istruzione-europeo-in-declino-rapporto-draghi-solo-l8-degli-studenti-ue-ha-alte-competenze-in-matematica-ecco-cosa-fare/).

Una vecchia storia, iniziata con la pubblicazione del “Libro bianco” del 1993, dove si sosteneva l’indiscutibile necessità del modello di istruzione/educazione per la competitività. Da quel momento hanno fatto irruzione nel dibattito di politica scolastica e poi nelle circolari, nelle norme e nelle varie indicazioni parole come autonomina didattica e organizzativa, programmazione e progettazione, kompetenze e orientamento, “apprendimenti”, “apprendere ad apprendere”, learning by doing, comunità educante, offerta didattica, individualizzazione, formazione continua, ecc…, fino alle odierne edutainment, easy learning, apprendimento gamificato, ecc.

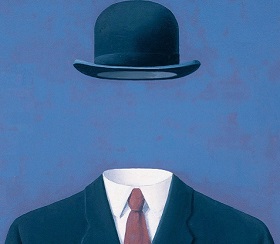

Il processo è stato sostenuto da una folta schiera di pedagogisti, didattisti e tecnologi dell’educazione impegnati a teorizzare modelli di integrazione che di fatto trasformano sempre più la pedagogia in ancella dell’economia di mercato e della razionalità neoliberale. La scuola pubblica, da questa prospettiva, non deve essere più scuola della Costituzione democratica postbellica – deputata all’alfabetizzazione alle culture disciplinari, alla trasmissione di conoscenza in vista della conquista di una certa autonomia culturale, alla formazione di un’opinione pubblica autonoma e critica, alla selezione (fondata sul merito e non sulla classe sociale di appartenenza) per la produzione di élite pubbliche, dirigenti pubblici e quadri sociali pubblici (capaci cioè di agire per l’interesse pubblico, non privato) – ma scuola della “inclusione subalterna” (A. Sayad): tutti devono essere inclusi nell’unico orizzonte del “realismo capitalista” (M. Fisher).

Ha ricordato Luciano Gallino:

«A partire dagli anni Ottanta, quando si delinea la crisi del capitalismo che i politici e il “partito di Davos” cercheranno di contrastare con la finanziarizzazione dell’intera economia […] l’attacco alla scuola […] è stato condotto dai governi e dalle istituzioni della Ue a colpi di riforme, aventi come principio ispiratore la trasformazione di esse in organizzazioni del tutto simili a un’impresa. Per legittimare una simile trasformazione sono stati utilizzati lo spauracchio della perdita di competitività nei confronti dei paesi emergenti; la necessità di difendere e migliorare la posizione del proprio paese negli scambi internazionali; e non da ultimo l’urgenza di combattere la disoccupazione. L’intero sistema, scuola e università, doveva essere ristrutturato come un’impresa che crea e accumula “capitale umano” […], un sistema la cui finalità non consiste affatto nel formare cittadini o ricercatori o studiosi, ma è piuttosto quella di formare individui che sin dagli inizi della loro formazione […] si concepiscano come “imprenditori di se stessi” […], che si pongano come supremo principio da seguire la produzione in se stessi di “competenze” utili ad accrescere il Pil» [L.Gallino, “Il denaro, il debito e la doppia crisi spiegati ai nostri nipoti”].

Il modello dell’istruzione/educazione per la competitività voluto dalle classi dirigenti europee è finalizzato alla formazione di “capitale umano”, funzionale e necessario agli sviluppi della “accumulazione capitalistica flessibile” (D. Harvey). Questo significa che l’istruzione per la competitività è il modello educativo di un regime produttivo fondato sulla delocalizzazione, sulla polverizzazione dei diritti AL lavoro e DEL lavoro, su politiche salariali deflattive, sul lavoro intermittente e a basso valore aggiunto.

Non a caso, il modello dell’istruzione per la competitività viene introdotto in Italia insieme alla precarizzazione del lavoro (1997) con l’autonomia scolastica (1997-1999). L’autonomia scolastica altro non è che la piena integrazione della scuola nel capitalismo: nella sua logica, nelle sue dinamiche riproduttive, nei suoi obiettivi. È la scuola deputata alla formazione del capitale umano, dotato delle kompetenze basilari richieste dall’organizzazione flessibile della forza-lavoro precaria, competitiva e sottopagata. È la scuola che da organo costituzionale (P. Calamandrei) si ristruttura in agenzia formativa per l’occupabilità e la competitività.

Secondo il paradigma della “occupabilità” e della competitività l’obiettivo della scuola pubblica non deve essere più l’inclusione in un curriculum di studi intellettualmente organico e rigoroso, grazie al quale conquistare livelli culturali superiori, apprendere un lavoro (specifico o generale), sviluppare la formazione della cittadinanza democratica, ma una socializzazione/pedagogizzazione delle masse da realizzarsi lungo tre assi:

– l’asse delle competenze deculturalizzate, finalizzato all’assimilazione di pacchetti di nozioni basilari per poter affrontare di volta in volta le situazioni mutevoli determinate dall’organizzazione flessibile del lavoro precario: del resto, i futuri lavoratori dovranno essere permanentemente “occupabili”, non stabilmente occupati; e dovranno continuamente acquisire (acquistare) “saperi ad uso e smaltimento istantaneo” (Z. Bauman) sul mercato della formazione continua e permanente, anche se tale formazione continua e permanente non porterà mai a nessuna stabilità economica e a nessuna realizzazione lavorativa e personale, anche se tale formazione permanente porterà, il più delle volte, a impieghi ancor più precari e casuali e ancor meno retribuiti.

Con la scuola delle competenze si realizza – forse per la prima volta nella storia moderna – la divaricazione fra istruzione e cultura: si può studiare anche per 8-13 anni e alla fine non conoscere niente della realtà;

– l’asse delle “educazioni” (alla raccolta differenziata, all’ambiente, contro le dipendenze, contro la ludopatia, alla salute, alla sessualità, alla cittadinanza digitale, all’affettività, al codice stradale, ecc. ecc.), attraverso cui diffondere la convinzione e l’ideologia che la soluzione delle patologie e delle contraddizioni sociali risieda nella “educazione”; i nessi sussistenti tra dinamica produttiva, trasformazione e deregolamentazione delle istituzioni e cultura dominante sono di fatto occultati (se le multinazionali promuovono nelle scuole l’educazione ambientale qualche problema ci sarà, o no?);

– l’asse della “pedagogizzazione delle masse”, il cui obiettivo – neanche troppo nascosto – è l’inclusione universale nella razionalità neoliberale e l’interiorizzazione di una morale che vuole convincere gli individui che la creazione di posti di lavoro dipenda dalla decisione degli individui di acquisire continuamente competenze e di attivarsi permanentemente per cercare un lavoro; una morale che, per conseguenza, colloca i fallimenti individuali non in una organizzazione riproduttiva incapace di garantire occupazione, stabilità e sviluppo personale per tutti, ma nell’individuo non sufficientemente “formato” e dunque non sufficientemente “meritevole” di accedere ad una qualche forma di sicurezza occupazionale ed economica (di qui l’ideologia della “meritocrazia”) e ad una realizzazione personale, scaricando così direttamente sulle spalle degli individui il peso (la “colpa”) della loro condizione di disoccupazione o precarietà.

La scuola dell’autonomia è la scuola meno democratica della storia dell’Italia repubblicana: è la scuola che trasforma gli studenti in clienti di competenze e che riduce i docenti a operatori didattici (se non addirittura a motivatori, facilitatori, animatori, “coreografi dell’apprendimento”, ecc.).

Chi continua a sostenere che per democratizzare la scuola pubblica c’è ancora bisogno di “riforme”, di formazione dei docenti, di innovazioni didattiche, ecc…, forse non ha capito che la scuola pubblica democratica era la scuola pre-autonomia, conquistata con la Costituzione antifascista e poi edificata grazie alle lotte di classe degli anni 50-70 (è stata quella l’unica scuola che ha realmente consentito un miglioramento delle condizioni materiali e un innalzamento delle condizioni culturali di tanti cittadini); forse non ha ancora capito che la scuola pubblica va oggi de-riformata (così Tomaso Montanari); forse non ha ancora capito che l’odierna scuola pubblica rischia di diventare sempre più scuola della post-democrazia (C. Crouch).

Non è difficile prevedere che, in assenza di una radicale inversione di marcia, la scuola pubblica finirà per essere la scuola di chi non ha alternative, ovvero la scuola di chi non potrà comperarsi (o indebitarsi per accedere a) una istruzione privata di qualità (la stessa qualità che la scuola pre-autonomia garantiva gratuitamente a tutti).